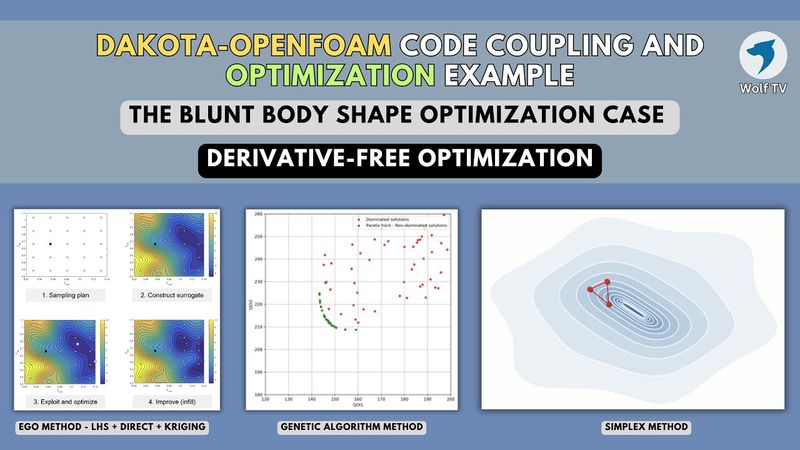

6. Ciclo di ottimizzazione DAKOTA-OpenFOAM | Ottimizzazione senza derivate

Informazioni sul download e dettagli del video 6. Ciclo di ottimizzazione DAKOTA-OpenFOAM | Ottimizzazione senza derivate

Autore:

Wolf Dynamics World - WDWPubblicato il:

10/04/2025Visualizzazioni:

155Descrizione:

Video simili: Ciclo di ottimizzazione DAKOTA

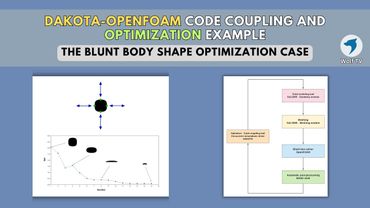

2. Esempio di accoppiamento e ottimizzazione del codice DAKOTA-OpenFOAM | Il caso di ottimizzazio...

3. Ciclo di ottimizzazione DAKOTA-OpenFOAM | Ottimizzazione basata sul gradiente

4. Ciclo di ottimizzazione DAKOTA-OpenFOAM | Casi di riavvio e cattura di errori di simulazione

5. Ciclo di ottimizzazione DAKOTA-OpenFOAM | Esplorazione dello spazio di progettazione (DSE)

Beginner to Pro FREE Excel Data Analysis Course