Экономическая математика Л14 IQ,MN,MR

Информация о загрузке и деталях видео Экономическая математика Л14 IQ,MN,MR

Автор:

Dilfuza EshmamatovaДата публикации:

05.12.2020Просмотров:

8Транскрибация видео

Здравствуйте, уважаемые студенты!

Тогда я начну лекцию.

У нас с вами сегодня следующая лекция.

Значит, сегодня у нас с вами лекция, которая называется вообще-то в общем случае предельной теоремой, то есть переход от теории вероятности к математической статистике.

Значит, тема нашей лекции «Закон больших чисел.

Неравенство Чебышева, теорема Чебышева и теорема Бернули».

С чего начнем?

Значит, обычно вообще на практике очень тяжело сказать, какое конкретное значение принимает случайная величина.

Однако, оказывается, при воздействии большого числа факторов, когда очень много факторов, поведение, когда мы берем несколько, много факторов,

больше чисел случайных величин, практически вот эта случайность утрачивает свой характер.

То есть и это становится закономерным.

Этот факт очень важен на практике, так как это нам позволяет предвидеть результат опыта при воздействии

большого числа случайных факторов.

Однако, оказывается, это возможно только при выполнении некоторых условий.

В любом случае, выполнение этих факторов невозможно.

Поэтому эти факторы, эти условия определяются законом больших чисел.

К законам больших чисел относятся теорема Чебышева,

Это наиболее общие случаи и теорема Бернулия это является простым случаем, частным случаем.

То есть практические деятельности вообще в практике большое значение имеют события с вероятностями близкими либо к единице, либо к нулю.

Отсюда получается, что одной из основных задач теории вероятности должно быть установление закономерностей, происходящих с вероятностями близкими к единице, то есть для почти достоверных событий, скажем так.

Так...

Теперь для того, чтобы ввести теоремы Чебышева и теоремы Бернули, я должна вам привести сначала неравенство Чебышева.

В чем заключается неравенство Чебышева?

Вообще неравенство Чебышева справедливо и для дискретных случайных величин, и для непрерывных случайных величин.

Для того, чтобы вам упростить задачу, мы с вами ограничимся сегодня только для дискретных случайных величин.

Значит, допустим, пусть у нас x – дискретная случайная величина, задана своим законом распределения.

Вот, значение x принимает x1, x2 и так далее, xn, соответствующие вероятности p1, p2 и так далее, pn.

Значит, основная задача состоит в чем?

оценить вероятность того, что отклонение случайной величины х от своего математического ожидания не превышает по абсолютной величины заранее заданного ε положительного числа, достаточно малого ε положительного числа.

То есть...

Если ε достаточно мало, тогда мы оценим то, что х будет принимать значения, почти равные к своему математическому ожиданию.

То есть оно будет максимально близко к своему математическому ожиданию.

Теперь...

Чебышев, значит, доказал неравенство, позволяющее дать этому оценку.

Что говорит неравенство Чебышева?

Вероятность того, что отклонение случайной величины х от своего математического ожидания, отклонение – это разность, по абсолютной величине, величине меньше, чем положительного числа ε,

Оказывается, вероятность этого события, x минус mx по абсолютной величине, что будет меньше какого-то маленького положительного числа ε, и вероятность этого числа больше либо равно 1 минус dx, то есть дисперсия деленная на ε в квадрате.

Вот это называется у нас неравенством Чебышева.

Значит, теперь...

Для того, чтобы доказать, мы с вами рассмотрим два события.

Какие события?

Мы возьмем первое событие, x отклонения случайной величины от своего математического ожидания по абсолютной величине меньше ε, и возьмем x минус mx, то есть отклонение больше равно ε.

Как вы видите, по смыслу неравенства эти два события взаимообратные, друг другу противоположные.

И у нас, если вы помните, сумма вероятности противоположных событий была равна единице, ребята.

Теперь, то есть вероятность этих двух событий равна единице.

Если мы перенесем в правую часть...

ту вероятность того события, что x минус mx будет больше либо равно ε, то есть ту вероятность того события, которое нас интересует, сводится к тому, что мы должны найти вероятность этого события.

То есть отклонение x от своего математического ожидания по абсолютной величине будет больше либо равно ε. Мы должны вот эту часть найти.

Как?

Будем находить.

Теперь.

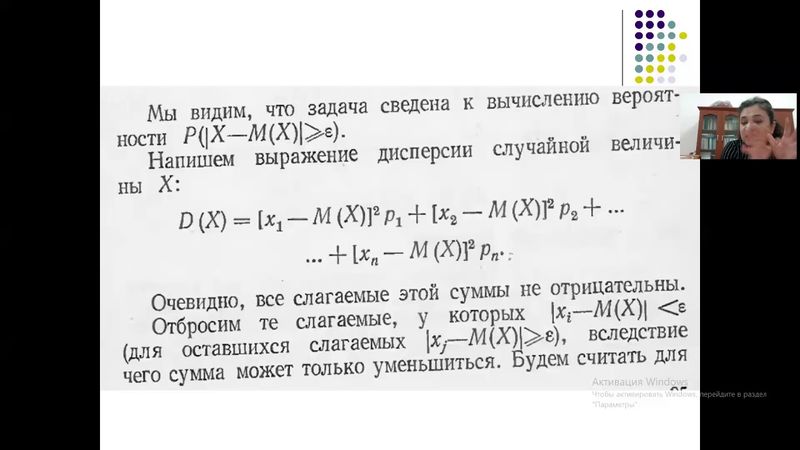

Давайте запишем сначала дисперсию.

Что такое дисперсия?

Давайте вспомним.

Что такое дисперсия?

Определение дисперсии.

Кто помнит?

Кто помнит определение дисперсии?

Есть кто помнит, ребята?

Дисперсия.

Эх вы!

Значит, это математическое ожидание квадрата отклонения случайной величины от своего математического ожидания.

Это надо знать.

И по определению дисперсии мы с вами распишем, вот, пожалуйста, х1 минус mx квадрат p1 плюс х2 минус mx квадрат p2 и так далее, хn минус mx квадрат pn.

Теперь, что мы должны сделать?

Вот как мы с вами рассмотрим, вот это выражение, оно не отрицательное, то есть оно положительное.

Почему?

Потому что вот эти квадраты все положительные, и вероятность, и также мы знаем с вами, вероятность принимает значение от 0 до 1, то есть они тоже положительные числа.

Теперь, если мы с вами, значит, мы сейчас рассмотрим эти величины, вот то, что в скобках квадраты,

И мы из этих квадратов отбросим те части, для которых выполняется вот это неравенство.

x и минус mx, то есть когда отклонение меньше ε, я выброшу.

А оставшиеся оставлю только те, которых xg минус mx больше равно ε. В таком случае, хоть мы отбрасываем маленькие числа, все равно положительное число уменьшается.

То есть мы от какого-то положительного числа часть числа отбросили.

Значит, правая часть у меня уменьшилась.

Допустим, вот эти, давайте возьмем так, допустим, у нас k штук из этих всех, для k штук вот этих слагаемых выполняется неравенство, когда x и минус mx по абсолютной величине меньше ε. И мы, допустим, запишем, как будто начинаем, ну для себя, чтобы удобно было, с k плюс 1 до n выполняется xg минус mx по абсолютной величине больше либо равно ε.

В таком случае, когда я отбрасываю, у меня получается дисперсия больше будет, чем эта сумма.

Теперь вот это неравенство, то, что мы взяли неравенство, возведу в квадрат.

С двух сторон имею право, обе стороны положительные.

И вместо вот этих квадратов я подставлю ε квадрата.

То есть эти числа больше, чем ε. То есть еще раз усилю неравенство.

То есть поставила меньшие значения.

Эпсилон квадрат, эпсилон квадрат, эпсилон квадрат.

И выношу за скобку.

У меня получается эпсилон квадрат, ПК плюс 1, плюс и так далее, ПН.

Вот какое выражение я получаю.

По теореме сложения вероятности, если вы помните, сумма вероятности, это есть вероятность того, что х примет одно из вот этих хк плюс 1, хк плюс 2 и так далее, хн.

Из этих значений только одно.

При любом из них отклонение будет удовлетворять вот этому неравенству, ребята.

То есть у меня вот эта сумма pk плюс 1 плюс pk плюс 2 и так далее плюс pn выражает вот эту вероятность, то есть x минус mx по модулю больше либо равно ε. Значит, мы вместо вот этого всего выражения теперь подставим вот данную нашу вероятность.

Тогда для того, чтобы эту вероятность найти, я поделю это неравенство на ε2.

Вот что мы получили.

Теперь то, что мы с вами получили, вот последнее неравенство, подставлю в неравенство звезды вот сюда.

И если я подставлю, мы с вами получим доказательство неравенства Чебышева.

Ребята, поняли, не поняли?

Вроде да.

Да?

Ребята, понятно?

Почему молчим?

Да, да.

Эх вы.

Гопаров не понял, да?

Ну, самостоятельно изучу, прочитаю потом.

Какую часть не понял, спроси.

Тема сложная, я ничего не могу сказать.

Сложная тема.

Какую часть не понял, Гапар?

Скажи, вообще не понял, да?

Да.

Вот смотрите, вообще мы что делаем?

Ладно, суть даже не в доказательстве.

Доказательство тяжело онлайн объяснить.

Суть заключается в чем?

Мы оцениваем разность...

случайной величины от своего математического ожидания.

То есть, что вот эта разность будет очень маленькая.

То есть, сама случайная величина принимает значение ближе.

То есть, почти одно и то же значение, что свое математическое ожидание.

Мы вот это событие оцениваем.

Оказывается, вероятность этого события больше, чем 1 минус dx, деленное на ε2.

Вообще, зачем оно нужно?

Это неравенство вообще носит теоретический характер.

У него в практике этого неравенства нету применения.

Почему?

Потому что оно дает очень грубую оценку.

Но для чего оно нам нужно?

А это неравенство мы будем использовать при доказательстве теоремы Чебышева.

А вот теорема Чебышева, она применима на практике.

Поэтому математика без фундаментальности никуда.

То есть

Есть те факты, которые носят чисто фундаментальный характер.

В данном случае то же самое.

Неравенство Чебышева носит только фундаментальный характер.

Но при помощи этого неравенства, если бы этого неравенства не было, очень тяжело доказать саму теорему Чебышева.

В чем заключается теорема Чебышева?

Что мы хотим доказать?

То есть оказывается, ребята,

Вот вы если будете рассматривать отдельно случайные, например, отдельные x1, отдельные x2, их оценить очень невозможно, вообще практически невозможно, потому что они...

Так как она случайна, вы не можете знать, какое значение первая случайная величина будет применять, вторая случайная величина.

То есть отдельно их оценить невозможно.

Но если мы возьмем целую группу случайных величин, n штук, n штук, тысячу, я не знаю, 500, 10 тысяч.

Потом, если мы возьмем среднее арифметическое,

Используя их среднее значение, оказывается общую картину можно предвидеть.

Вот для чего нужен нам закон больших чисел.

То есть, что говорит теорема Чебышева?

Теорема Чебышева говорит, что если мы возьмем n штук, ну, несколько, ну, 100 штук, 1000 штук, например, да, n, чем больше, тем точнее у нас будет оценка.

Если мы возьмем n штук попарно независимых случайных величин, то есть n штук, они все попарно независимые,

Причем, какие условия должны быть?

Смотрите, я взяла n штук случайной величины.

Во-первых, они должны быть попарно независимы, то есть друг другу они не должны мешать.

Во-вторых, дисперсии их равномерно ограничены.

Что это значит?

Их дисперсии не превышают какого-то постоянного числа s. То есть они меньше либо равно числа s, как константы, то есть ограничены сверху.

И что говорится, каково бы ни было число ε маленьким, оно маленькое число, ближе к нулю, оказывается среднее арифметическое этих случайных величин, то есть вы когда возьмете n штук случайных величин и возьмете их среднее арифметическое, потом...

разность от среднего арифметического их, отнимите среднее арифметическое их математических ожиданий, то есть взяли потом отдельно их математические ожидания и взяли среднее арифметическое.

И вот эта разность по абсолютной величине,

вероятность вот этого события рассмотрим, что оно будет меньше, чем эпсилон.

Оказывается, вероятность этого события почти достоверное событие.

То есть, чем больше вы берете вот эти попарно независимые случайные величины, предел этого события стремится к единице.

Предел, я не сказала сама вероятность.

Вероятность конкретно посчитать равно 1 не может, нельзя сказать.

Я вам поэтому говорю, почти достоверное событие, потому что предел этого события, когда n стремится к бесконечности, то есть чем больше вы берете случайные события, тем быстрее оно стремится к 1.

Вот что говорит, что утверждает теорема Чебышева.

Теперь,

Я вам только что объяснила, как мы будем доказывать.

Для того, чтобы доказать эту теорему, введем случайную величину.

Как?

Мы возьмем среднюю арифметическую, обозначим через x шапочкой.

Давайте.

Вот n, фактически здесь сумма n случайных величин.

Я возьму его, обозначу через одну другую.

Пусть будет x шапочкой.

Посчитаем, что его заодно целое.

Теперь, если вы помните, свойство математического ожидания заключалось в чем?

сумма двух и более конечного числа случайных величин, математическая ожидания от суммы два и более случайных величин конечного числа равно сумме их математических ожиданий.

Вот по этому свойству.

И потом плюс к этому можно было постоянное число вынести за знак математического ожидания.

Вот мы это и делаем.

n я вынесла и сумму математических ожиданий посчитала.

Теперь

Если мы применим к этому теорему Чебышева, ой, не равенство Чебышева, извиняюсь, вот x минус mx по модулю меньше ε. Вот вместо x я ставлю вот, пожалуйста, среднее арифметическое, потому что это x шапочка минус mx шапочка меньше ε. Это оказывается больше либо равно...

1 минус дисперсия деленный эпсилон квадрат.

Я пошагово иду, но просто сразу написали.

Здесь можно было сначала x шапочкой написать и сюда x, вам было бы более понятно.

И если теперь смотрим, что мы делаем?

Теперь учтем вот это неравенство.

То есть, опять-таки вернемся к свойству дисперсии.

Я должна вот эту дисперсию раскрыть.

Что говорит свойство дисперсии?

Если вы помните, дисперсия то же самое было.

Дисперсия суммы двух и более конечного числа случайных величин было равно сумме их дисперсий.

И еще число константу можно было вынести как квадрат.

Вот мы так и сделали.

Вот, пожалуйста.

Теперь, если вы помните, в условии теоремы дисперсии были ограничены, ребята, то есть они были меньше либо равно какого-то константа S, то есть каждая дисперсия ограничена одним и тем же числом, то есть максимальное значение дисперсии, нет любой дисперсии из этих случайных величин.

для любой из них, не больше какого-то положительного числа s. Теперь подставлю вместо dx.

То есть я вот это выражение усиливаю, ставлю максимальное значение s плюс s и так далее.

В итоге у меня получается n штук s. 1n сокращаю, значит, вот это выражение e у меня меньше равно s деленное на n. Теперь все то, что я вычислила, подставляю в неравенство.

Вот это неравенство.

Что мы получаем в итоге?

В итоге мы получаем с вами 1 минус c деленное n эпсилон квадрат.

Если я перейду к пределу.

Вопрос, ребята, слушайте меня внимательно.

Азот Агапаров, Дурдона, кто еще там у нас?

Асулова.

Смотрите, вот это выражение к чему стремится?

c деленное n эпсилон квадрат, когда n стремится к бесконечности.

Ну-ка.

К бесконечному...

Нулю.

Нулю, потому что знаменатель у вас, ребята, стремится к бесконечности.

Число на бесконечность – это 0.

И в итоге я получаю вот это неравенство.

Смотрите, лимит разность средних арифметических случайных величин от их математического ожидания, среднего арифметического, больше либо равно 1.

Но, ребята, если вы помните…

Мы с вами уже целое семейство проходим.

Вероятность не может быть больше единицы.

Согласны?

Здесь же мы вероятность оцениваем.

П у меня вероятность события.

Оно не может быть больше единицы.

Поэтому это неравенство выполняется в том случае, только если оно равно единице.

Вот мы с вами доказали данную теорему.

Не сложно доказать, так кажется, что сложно.

Теперь, что мы с вами рассмотрели?

Мы с вами рассмотрели тот случай, когда мы с вами взяли n случайных величин, и у них разные математические ожидания, но оказывается на практике не так.

Большинство случаев на практике,

Случайные величины вы берете, если взаимно попарно независимые друг другу, исключающие друг друга, то есть и вы берете, что у них диспрессия ограничена.

Если вот эти условия выполняются, оказывается, у таких случайных величин на практике в основном математические ожидания одинаковые.

То есть они...

разные математические ожидания могут иметь.

Поэтому мы с вами эти математические ожидания, давайте сейчас частный случай теоремы рассмотрим.

Возьмем, что mx1 равен mx2 и так далее, равен mxn, то есть у них математические ожидания одинаковые, и мы его обозначим через а маленькую.

И теперь рассмотрим частный случай этой теоремы.

Оказывается, если у вас даны n случайных величин, попарно-независимые,

который имеет одно и то же математическое ожидание, то есть у них математические ожидания одинаковые,

равно а, и если у них дисперсии равномерно ограничены, то есть дисперсии меньше либо равно какого-то положительного числа c, тогда каково бы мало ни было эпсилон число, положительное, но маленькое, разность вот этого среднего арифметического, смотрите, если вы возьмете, а здесь у вас получится просто n, а зеленое на n, n сократится, поэтому минус а.

Вероятность вот этого события почти достоверное событие.

То есть, когда мы рассматриваем вероятность вот этого события, и при n стремящемся к бесконечности, вероятность этого события равно единице.

То есть, оказывается, отдельные случайные величины могут иметь значительный разброс.

но их среднее арифметическое, если возьмете, оно будет рассеяно очень мало.

То есть нельзя уверенно предсказать, какое возможное значение примет каждая отдельно взятая случайная величина, но целую группу случайных величин вы можете взять и его оценить.

То есть среднее арифметическое, среднее вы, зная характер нескольких,

случайных величин, общую картину для среднего для всех вы можете предсказать.

Вот для чего нужно теорема Чебышева.

Теперь, что я хочу сказать.

Теорема Чебышева вообще, как я вам сказала, как и неравенство Чебышева, оно, значит, действует, то есть оно справедливо и для дискретных случайных величин, и для непрерывных случайных величин.

Вот теперь давайте посмотрим более частный случай, упрощенный, теорему Бернули.

В чем заключается?

Ребята, если вы помните, я с вами, мы с вами проходили, значит, вероятность событий классического апреля.

Что такое вероятность случайного события?

Что такое относительная частота?

В чем разница?

Ну-ка, кто мне может сказать, что такое относительная частота?

Что такое вероятность события?

Ну-ка, две минуты, думаем.

Не молчим, думаем.

Ребята?

Вопрос повторите, пожалуйста.

Что такое вероятность случайного события и что такое относительная чистота?

В чем разница вероятности и относительной частоты?

В чем у них разница?

Ну-ка, ребята, кто знает?

Вообще не читаем, да?

Да, паров?

Что такое вероятность события?

Это число.

Какое число?

Не больше единицы.

Это понятно.

Вероятность случайного события.

Что это такое?

Это отношение числа... Какого числа?

То есть вероятность, он еще не посчитан, может быть, еще не, как бы, еще не произошло.

Да, это прогноз.

А частота событий мы можем посчитать то, что уже произошло.

Вероятность — это прогноз.

Это, как вам сказать, гадание, грубо говоря, да, вот, предсказание.

А вот относительная частота – вы уже все сделали.

То есть вероятность события, отношения числа, благоприятствующих данному событию, к общему, может быть, проводимому числу всех событий.

Но относительная частота – это отношение числа произошедших,

в которых произошло событие А, к общему числу событий.

То есть относительная частота – это анализ уже сделанного шага, а вероятность – это предсказание.

Оказывается, в чем заключается суть теоремы Бернули?

Суть теоремы Бернули заключается в оценке разности вот этого предсказания от факта.

Поняли, да, что мы заключаем?

В первом, в теореме Чебышева мы с вами рассматривали разницу случайного события от своего математического ожидания, а в теореме Бернули мы с вами смотрим разницу от относительной частоты и вероятности.

Оценку даем w минус p, то есть мы рассмотрим n независимых испытаний точно так же.

и в каждом из которых событие А, допустим, пусть у нас событие А имеет одну и ту же вероятность, только для таких случаев, для разных вероятностей мы не рассмотрим здесь.

Пусть событие А имеет одинаковую вероятность P. Вопрос.

Можно ли предвидеть, какова будет примерно относительная частота появления событий?

То есть, если вероятность события в этих N испытаниях одинаковая, мы можем ли оценить

заранее, какова будет уже после выполнения вот этой относительной чистоты, то есть чему будет равно?

Можем ли мы это число оценить?

На этот вопрос доказал Яков Бернули в 1713 году.

Эта теорема получила название «Закон больших чисел» и очень большой, значит, большой шаг, то есть вообще поставлена была

Наука в том же году, значит, это была революция начала науки теории вероятности.

Но доказательство было очень сложное.

Его через полтора, почти через полтора века, вот как вы видите, 130 с чем-то, 133, да, через 133 лет, значит, доказал Чебышев.

Намного упростил он доказательство.

Теперь, в чем заключается теорема Бернули?

То есть мы рассмотрим N событий независимых испытаний,

например, бросаете тысячу раз монету, да, в каждом из которых вероятность появления события А одинаковая, либо берете, например, 10 тысяч рожденных детей, в каждом из них, каждый ребенок, то, что родится мальчик, это 0,51, я вам уже говорила несколько раз, то, что девочка родится, 0,49, например, да, это постоянное число, оно никуда не войдет, в среднем оно всегда одинаковое.

Теперь вопрос, то, как

вероятность того, что отклонение относительной частоты, вот я пишу по-математически, от вероятности P этого события по абсолютной величине будет меньше ε, но ε маленькое число.

То есть, что я говорю, что разница относительной частоты от вероятности будет мала, то есть они будут почти близки друг к другу.

Чем больше вы берете независимые испытания, оказывается,

То есть тем больше возьмете этих детей, количество детей будете изучать, тем более достоверно это событие.

То есть когда n стремится к бесконечности, разница относительно частоты и вероятность этого события, что эта разница будет от хлонения меньше, чем ε, вероятность этого события стремится к единице.

Понятно, ребятам?

Ага, да.

Теперь, для того, чтобы доказать, ну, вообще, доказать я бы хотела, чтобы вы сами посмотрели.

Для того, чтобы доказать, мы возьмем x1 дискретно случайное величину числа появления событий в первом испытании, x2 во втором и так далее, xn в n. Вот.

Ну, как я вам сказала, каждый из этих величин может принимать только 2 вероятности.

Значение 1 с вероятностью p, значение 0 с вероятностью 1-p, то есть q.

Теперь вопрос, можем ли мы применить к этим величинам теорему Чебышева.

Оказывается, можно.

Если они, во-первых, для того, чтобы мы применили теорему Чебышева, там были свои условия.

Во-первых, они должны быть попарно независимы.

Во-вторых, у них дисперсии должны быть ограничены.

Оба условия здесь выполняются.

Попарно независимость есть.

Дисперсия ограничена, почему?

Потому что p плюс q, когда 1 сумма этих чисел, произведение p на q, максимальное значение будет иметь 1 четвертую.

Если вы помните, дисперсия каждой из них, npq было, в каждом из них 1 умножено pq, это будет максимум 1 четвертая, поэтому можем мы за c, которое ограничение для дисперсии, мы можем взять 1 четвертую, поэтому можем применить.

Если мы применим теорему Чебышева, вот, пожалуйста, мы получим следующее выражение Е. То есть, если мы с вами допустили, что математическое ожидание равно для каждого из них А, тогда оно равно чему?

Вот.

Просто nP было, n умножено на P. То есть, если вы помните, когда n испытания проводим, математическое ожидание было равно n умножено на P. Дисперсия nPQ.

Значит, в каждом испытании одно испытание умножено на P. То есть, у нас математическое ожидание в данном случае получается равно P.

И теперь мы должны показать, что вот это среднее арифметическое равно относительной частоте.

Действительно, каждая из этих величин при появлении событий в соответственном испытании принимает значение только равное единице, как я вам сказала.

Значит, вот эта сумма х1, х2, плюс и так далее, хn равна числу m появления в n испытаниях события а. То есть вот это у вас n сверху, а здесь m.

Поэтому вот мы и получили окончательно доказательство этого теоремы.

Очень просто.

Вот как вы видите, мы с вами, вообще-то теорема Чебышева сверху дает, выше дает оценку, и мы с вами после, обычно обратно должно быть, но смогли сверху вниз пойти и доказать более упрощенный вариант теоремы, в частном случае теоремы Бернули.

Так, теперь, что сегодня мы с вами прошли?

Ну, я вам этот слайд скину, вы можете сами почитать, сколько раз Пирсон монету бросал, Бюффен что делал, там все расписано, вы можете сами почитать.

этот историю на историю время тратить не буду ребята поэтому вопросы и что мы с вами сегодня прошли значит мы с вами я вам дала основные предельные теоремы для того чтобы дать основные предельные теоремы я вам сначала доказала неравенство чебышева потом теорему чебышева и теорему бернулли вот эти три в 3 и частный случай теоремы чебышева тоже

Значит, вот эти 4, 3 теоремы и плюс Нерайса Чебыша вы должны знать, у вас должен слетать зубов.

И суть понять, не только вызубрить, в чем заключается, что мы оцениваем и что мы получаем, и зачем они нам нужны на практическом применении.

Понятно, ребята?

Понятно.

Тема сложная, ничего не могу сказать.

Сложно, надо будет сесть дома разобраться.

У вас на практике тоже будут задачки на оценивание таких частных случаев, событий.

Если вопросов нет, я лекцию закончила.

Вопросы есть, нет?

Нет, вопросов нет.

Если нет, то как раз и время закончилось.

До свидания.

До свидания.

Спасибо за лекцию.

До свидания.

Спасибо.

Всего доброго.